La repressione tecnologica avanza. Ma avanzano anche i mezzi per eluderla.

di Massimo Introvigne

Sento dire ogni tanto che la possibilità per chi è ricercato o perseguitato in Cina e incluso nelle liste nazionali dei sospetti ormai espatriare per chiedere asilo in Paesi democratici è diventato impossibile, a causa del perfezionamento dei sistemi di riconoscimento facciale che identificano i passeggeri degli aerei al momento di richiedere una carta d’imbarco. Corrompere un funzionario per avere un passaporto che in teoria non dovrebbe essere rilasciato o anche perché escluda il proprio nome dalla banca dati Policenet non sarebbe più sufficiente.

Sono un sociologo delle religioni che da anni si occupa di minoranze perseguitate in Cina. Ho intervistato e continuo a intervistare centinaia di rifugiati – musulmani uiguri, buddhisti tibetani, praticanti del Falun Gong, membri della Chiesa di Dio Onnipotente e cristiani di Chiese domestiche – in una decina di Paesi diversi. Parallelamente, mi interesso da tempo alla criminalità organizzata cinese (le cui branche principali trovano le loro remote origini in confraternite religiose), tema sui cui ho anche tenuto corsi all’UNICRI di Torino, l’agenzia delle Nazioni Unite per la ricerca sulla criminalità.

Questa duplice prospettiva – religiosa e criminale – mi consente di osservare con chiarezza un punto spesso trascurato: le tecnologie biometriche negli aeroporti cinesi non hanno mai costituito una barriera assoluta all’espatrio di chi fugge dalla Cina, e non la costituiscono neppure oggi.

1. Prima e dopo il COVID: due mondi diversi

È vero che la Cina ha investito enormemente nel riconoscimento facciale. Ma occorre distinguere le fasi.

Fino al 2019 il sistema era ancora in fase sperimentale: secondo SITA, solo il 27% degli aeroporti cinesi disponeva di gate biometrici.

La piena estensione è avvenuta durante e dopo la pandemia, quando la digitalizzazione dei controlli è stata accelerata e resa più uniforme.

Ne consegue che chi è espatriato prima del 2020 si è trovato di fronte a un sistema incompleto, imperfetto e non applicato ovunque. Esaminare oggi casi di rifugiati che hanno lasciato la Cina nel decennio scorso, come se la barriera fosse già pienamente operativa nel 2019 o addirittura nel 2015 significa proiettare all’indietro una realtà che si è consolidata solo in seguito.

2. Corruzione e criminalità: sempre un passo avanti

Gli studi sulla corruzione in Cina (e altrove) mostrano un dato costante: la criminalità organizzata si adatta alle nuove tecnologie con sorprendente rapidità.

In Cina esiste un vero e proprio mercato nero, ampiamente documentato, di dati biometrici e personali, sottratti dai sistemi statali e rivenduti online. Una volta penetrati nei sistemi, gli hacker non si limitano a estrarre dati: possono anche alterarli o cancellarli, aprendo la strada a chi ha interesse a far sparire i propri o alterarli con “bug” che li rendono inutilizzabili.

Nel 2025 operazioni di polizia hanno dimostrato che gruppi criminali cinesi riescono a bypassare i sistemi di riconoscimento facciale, manipolando gli account digitali. Se tali tecniche funzionano per i ben protetti sistemi bancari, è plausibile che analoghe strategie vengano impiegate anche per i controlli aeroportuali.

Non è un caso che diversi capi della criminalità organizzata cinese – bersagli naturali del riconoscimento facciale – continuino a uscire dal Paese e siano poi identificati e talora arrestati all’estero, Italia compresa. Come riescono a uscire dalla Cina, e in qualche caso a entrare e uscire più volte? Evidentemente, i sistemi non sono impermeabili.

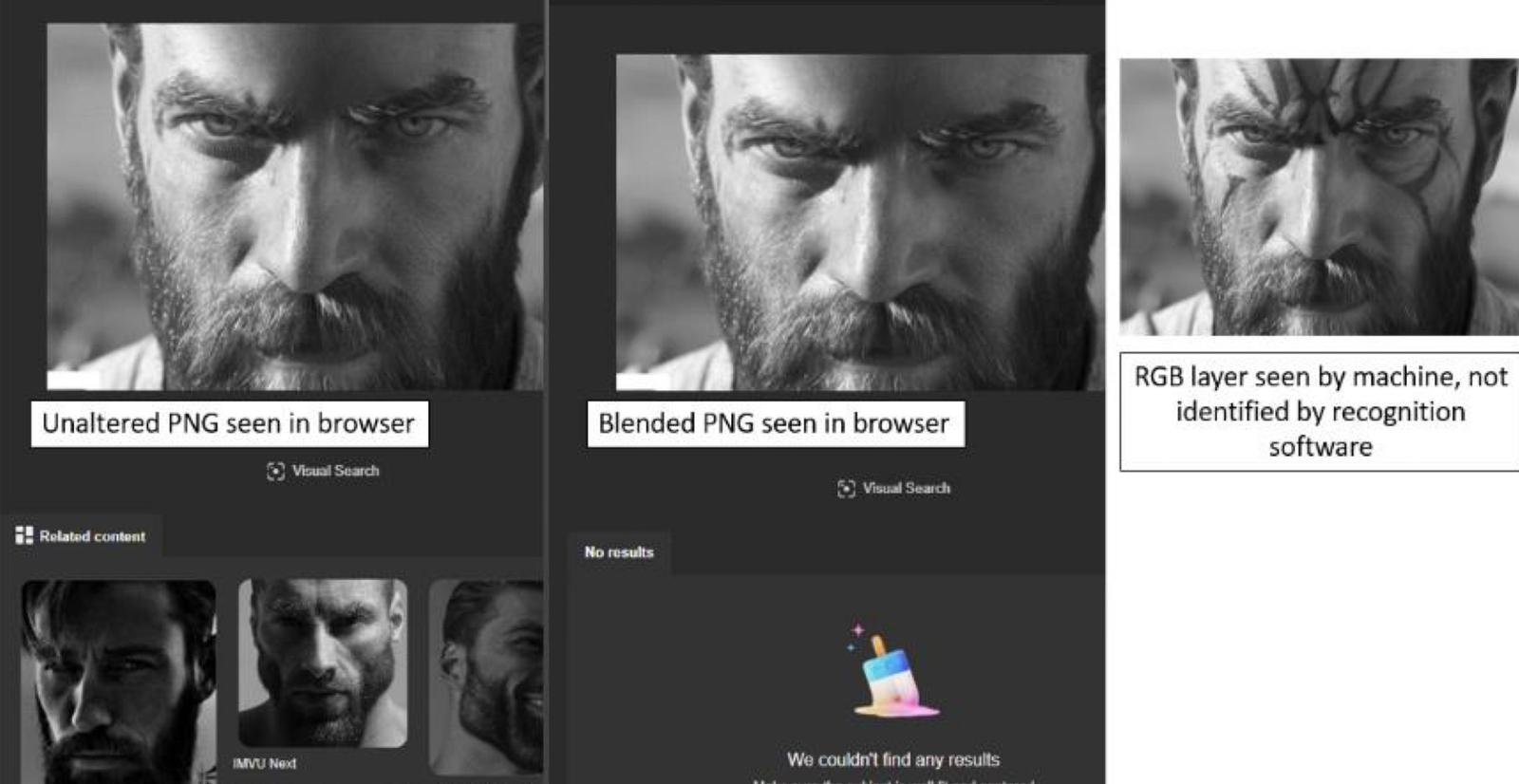

3. Ingannare le macchine: tecniche documentate

La letteratura specializzata documenta che il riconoscimento facciale può essere aggirato con metodi non accessibili a chiunque, ma noti ai poliziotti corrotti, ai criminali e a chi si rivolge a loro per essere aiutato a ingannare i sistemi aeroportuali. Tre in particolare vanno segnalati e mi sono stati illustrati anche da rifugiati che li hanno utilizzati. Il loro sviluppo è in corso fin dal decennio iniziato nel 2010.

Il primo è il cosiddetto “make-up asimmetrico”, originariamente chiamato “CV Dazzle” nella versione creata dall’artista Adam Harvey nel 2010, ma oggi molto perfezionato dopo che le macchine hanno imparato a reagire al “sistema Harvey”, che aveva anche lo svantaggio di lasciare tracce visibili sul volto delle persone che lo usavano. Oggi si usano invece pattern più discreti con effetti di luce e ombra che spezzano le linee del volto e confondono gli algoritmi. Questa tecnica è relativamente semplice ma sorprendentemente efficace. Sul tema esiste già letteratura scientifica.

Il secondo sistema usa le “adversarial patches”: motivi stampati su vestiti o accessori come gli occhiali che alterano i pixel e ingannano i software.

La terza tecnica si affida a LED a infrarossi invisibili: dispositivi applicati a cappelli o occhiali che proiettano punti di luce impercettibili all’occhio umano ma devastanti per le telecamere.

Queste tecniche non sono alla portata di un artista dissidente che si presenta ingenuamente al check-in. Ma sono note a chi avvicina per espatriare ambienti criminali o funzionari corrotti che offrono “servizi” a pagamento.

4. Le COI e la realtà empirica

Le COI che si soffermano sui miglioramenti della repressione tecnologica parlano di “alcuni” o “parecchi” dissidenti bloccati alla frontiera, ma non affermano mai che “tutti” siano fermati. La mia esperienza conferma questa sfumatura: molti rifugiati, e persino figure di spicco della criminalità organizzata, riescono a uscire dalla Cina.

L’idea che il riconoscimento facciale renda “obsoleti” i racconti dei rifugiati è una semplificazione. Prima del 2020 il sistema era incompleto. La corruzione e la criminalità hanno sempre dimostrato di stare al passo con la tecnologia. Infine, esistono tecniche documentate per ingannare gli algoritmi, accessibili a chi dispone di risorse o contatti. Si tratta di tecniche “a monte”, che consistono nell’intervento di hacker o semplicemente di funzionari corrotti con accesso al sistema per causare “bug” che causano malfunzionamenti rispetto a una persona specifica, oppure di tecniche “a valle” in cui chi desidera espatriare è istruito su come ingannare le macchine o munito di device atte allo scopo come i LED a infrarossi. Naturalmente, l’uso di queste device non è necessario se il sistema è già stato alterato “a monte” grazie alla corruzione.

La realtà è più complessa: “alcuni” dissidenti vengono fermati, ma altri riescono a partire. È proprio questa complessità che rende a mio avviso spesso credibili le testimonianze di rifugiati che raccontano di aver lasciato la Cina nonostante i controlli biometrici.

Bibliografia essenziale

I. La corruzione in Cina, gli hacker, e la possibilità di ottenere aiuto da funzionari corrotti

Ang, Yuen Yuen. 2020. “China’s Gilded Age: The Paradox of Economic Boom and Vast Corruption.” Cambridge: Cambridge University Press.

Greenberg, Andy. 2024, “China’s Surveillance State Is Selling Citizens’ Data as a Side Hustle.” “Wired,” November 21.

Transparency International. “Corruption Perceptions Index 2019: China Country Report.” Berlin: Transparency International, 2019.

Wedeman, Andrew. “Double Paradox: Rapid Growth and Rising Corruption in China.” Ithaca: Cornell University Press, 2012.

II. Il progresso dei sistemi di riconoscimento facciale in Cina e i loro limiti

DotDotNews. 2025. “Fraudsters Bypass Facial Recognition to Launder HK$274 mn.” October 17.

Qiang, Xiao. 2029. “The Road to Digital Unfreedom: President Xi’s Surveillance State.” “The Journal of Democracy” 30(1):53–67.

SITA. 2019. “China’s Airlines and Airports Take Automation to Next Level.” Press Release, November 28.

III. Tecniche per ingannare o eludere il riconoscimento facciale

Claburn, Thomas. 2025. “Even Modest MakeUp can Thwart Facial Recognition.” “The Register,” January 15.

Harvey, Adam. 2023. “CV Dazzle.”

Hwang, Ren-Hung, Jia-You Lin, Sun-Ying Hsieh, Hsuan-Yu Lin ,and Chia-Liang Lin. 2023. “Adversarial Patch Attacks on Deep-Learning-Based Face Recognition Systems Using Generative Adversarial Networks.” “Sensors” 23(2):1–29.

Komkov, Sergey, and Aleksandr Petiushko. 2019.“AdvHat: Real-World Adversarial Attack on ArcFace Face ID System.” “arXiv” 1908.08705.

Noever, David A., and Forrest G. McKee. 2024. “Novel AI Camera Camouflage: Face Cloaking Without Full Disguise.” “arXiv” 2412:13507.

Sharif, Mahmood, Sruti Bhagavatula, Lujo Bauer, and Michael K. Reiter. 2016. “Accessorize to a Crime: Real and Stealthy Attacks on State-of-the-Art Face Recognition.” In “CCS ‘’16: Proceedings of the 2016 ACM SIGSAC Conference on Computer and Communications Security,” October 24, 1528–540.

Zhe Zhou, Di Tang, Xiaofeng Wang, Weili Han, Xiangyu Liu, and Kehuan Zhang. 2018. “Invisible Mask: Practical Attacks on Face Recognition with Infrared,” “arXiv,” March 13, 1803:04683.

Massimo Introvigne (born June 14, 1955 in Rome) is an Italian sociologist of religions. He is the founder and managing director of the Center for Studies on New Religions (CESNUR), an international network of scholars who study new religious movements. Introvigne is the author of some 70 books and more than 100 articles in the field of sociology of religion. He was the main author of the Enciclopedia delle religioni in Italia (Encyclopedia of Religions in Italy). He is a member of the editorial board for the Interdisciplinary Journal of Research on Religion and of the executive board of University of California Press’ Nova Religio. From January 5 to December 31, 2011, he has served as the “Representative on combating racism, xenophobia and discrimination, with a special focus on discrimination against Christians and members of other religions” of the Organization for Security and Co-operation in Europe (OSCE). From 2012 to 2015 he served as chairperson of the Observatory of Religious Liberty, instituted by the Italian Ministry of Foreign Affairs in order to monitor problems of religious liberty on a worldwide scale.